Das Verfügbarkeitsproblem hat von Ops zu Dev gewechselt

Jahrelang war Verfügbarkeit ein Operations-Problem. Server gingen down. Load Balancer versagten. DNS propagierte langsam. Engineering-Teams bauten Redundanz, Failovers und Monitoring, um Production am Laufen zu halten. Diese Disziplin wurde zur zweiten Natur.

Nun hat dasselbe Problem in die Entwicklung selbst migriert.

Wenn dein Coding-Workflow von einem cloud-gehosteten LLM abhängt, ist ein Anbieterausfall dein Ausfall. Nicht in Production. Auf deinem Rechner. In deinem Editor. Während du gerade liefern willst.

Wie Anbieterabhängigkeit wirklich aussieht

Es beginnt klein.

Du nutzt einen KI-Assistenten, um ein Feature zu gerüsten. Dann um Tests zu schreiben. Dann zum Debuggen. Dann zum Refactoring von unbekanntem Code. Jeder Schritt ist schneller als manuell, also vertieft sich die Gewohnheit.

Irgendwann hilft der Assistent dir nicht mehr beim Coden. Er codiert, während du beaufsichtigst. Manche nennen das Vibe Coding. Der Begriff ist lässig. Die Abhängigkeit ist es nicht.

Wenn der Anbieter ausfällt, ist die Auswirkung sofort:

- Features stagnieren mitten in der Implementierung.

- Code, den du abgenommen hast, ohne ihn vollständig zu verstehen, wird undurchsichtig.

- Deadlines rutschen, weil die angenommene Geschwindigkeit nie deine war — sie war die des Modells.

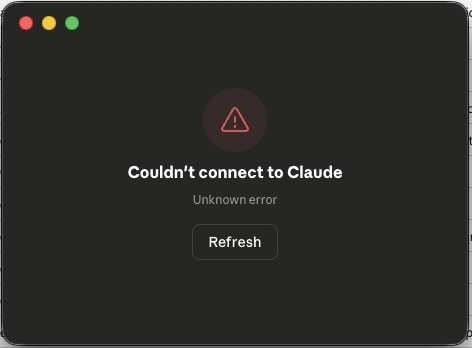

Ein vertrauter Anblick, wenn Anbieter-Verfügbarkeit dich mitten im Workflow im Stich lässt.

Ein vertrauter Anblick, wenn Anbieter-Verfügbarkeit dich mitten im Workflow im Stich lässt.

Das ist kein theoretisches Risiko. Jeder große Modellanbieter hatte 2025 und 2026 Ausfälle. Manche dauerten Stunden. Für Teams mitten in KI-gestützten Sprints zählen Stunden.

Das tiefere Problem: Verständniserosion

Verfügbarkeit ist das sichtbare Symptom. Der zugrundeliegende Zustand ist schlimmer.

Wenn Entwickler zu viel Reasoning an ein Modell auslagern, verlieren sie schrittweise den Kontakt zu ihrer eigenen Codebase. Die Architektur ergibt Sinn, wenn der Assistent sie erklärt. Die Muster fühlen sich richtig an, wenn der Assistent sie generiert. Aber nimmt man den Assistenten weg, ist das mentale Modell dünn.

Das ist keine Frage des Skill-Levels. Senior-Entwickler mit Jahrzehnten Erfahrung können in dieses Muster verfallen. Das Tool ist so effektiv. Die Bequemlichkeit so verführerisch.

Das Ergebnis ist eine neue Art von Fragilität. Nicht im System. Im Team.

Ein Entwickler, der ohne Modellzugang nicht weiterarbeiten kann, nutzt kein Tool. Dieser Entwickler ist abhängig von Infrastruktur — Infrastruktur, die jemand anderem gehört und betrieben wird, ohne SLA, das einem Entwicklungsdeadline entspricht.

Anbieterwechsel löst es nicht

Die offensichtliche Antwort ist Anbieter-Diversifizerung. Wenn Claude down ist, wechsel zu GPT. Wenn GPT down ist, probiere Gemini.

Das funktioniert auf dem Papier. In der Praxis ist es kostspielige Reibung.

Jedes Modell hat unterschiedliche Stärken, Context-Window-Verhalten und Fehlermodi. Prompts, die bei einem Modell saubere Ausgabe produzieren, können bei einem anderen Rauschen erzeugen. Benutzerdefinierte Instruktionen, Agentenkonfigurationen und Workflow-Integrationen sind anbieterspezifisch.

Mitten in einer Aufgabe zu wechseln führt zu Kontextverlust, Inkonsistenz und Nacharbeit. Das ist das Entwicklungsäquivalent eines Failovers auf eine kalte Standby-Datenbank — technisch möglich, operativ schmerzhaft.

Anbieter-Diversifizerung ist eine Minderung, keine Lösung.

Die Netzwerkabhängigkeit, über die niemand spricht

Es gibt noch eine weitere Dimension: Jeder Prompt, jedes Code-Snippet, jede Datei, die du an ein Cloud-Modell sendest, reist über das Internet zu den Servern von jemand anderem.

Für viele Projekte ist das in Ordnung. Für andere ist es ein ernstes Anliegen. Proprietäre Geschäftslogik. Unveröffentlichte Algorithmen. Sicherheitssensitiver Infrastrukturcode. Interne API-Designs. All das geht über einen externen Netzwerkpfad zu einem Drittanbieter-System.

Die meisten Teams denken nicht daran, bis Compliance fragt. Dann ist die Gewohnheit bereits etabliert.

Das Verfügbarkeitsproblem und das Datenexpositionsproblem teilen dieselbe Ursache: Dein Entwicklungsworkflow hängt von einer Netzwerkverbindung zu einem Anbieter ab, den du nicht kontrollierst.

Lokale Modelle sind der strukturelle Fix

Die langfristige Antwort entsteht: lokale Coding-Modelle, die direkt auf dem Rechner des Entwicklers laufen.

Hardware holt auf. Apple Silicon liefert Unified-Memory-Architekturen, die quantisierte Modelle mit akzeptabler Performance ausführen können. High-VRAM-GPUs werden zugänglicher. Modell-Quantisierungstechniken haben sich deutlich verbessert.

Ein fähiges, lokal laufendes Coding-Modell löst zwei Probleme auf einmal:

- Verfügbarkeit — Keine Netzwerkabhängigkeit. Kein Anbieterausfall. Das Modell läuft, ob dein Internet oben ist oder nicht.

- Datensouveränität — Dein Code verlässt nie deinen Rechner. Keine Drittanbieter-Datenverarbeitung. Keine Compliance-Grauzonen.

Lokale Modelle sind noch nicht auf Augenhöhe mit den größten Cloud-Modellen. Kontextfenster sind kleiner. Reasoning-Tiefe ist seichter bei komplexen Aufgaben. Aber für einen großen Anteil der täglichen Coding-Arbeit — Vervollständigungen, Refactoring, Testgenerierung, Dokumentation — reichen sie bereits aus.

Die Trajektorie ist klar. Lokale Modelle werden sich verbessern. Die Lücke wird sich verengen. Teams, die jetzt beginnen, local-first KI-Workflows aufzubauen, werden einen strukturellen Vorteil haben, wenn die Modelle die Fähigkeitsschwelle überschreiten.

Was das für deinen Workflow bedeutet

Du musst Cloud-Modelle nicht aufgeben. Sie bleiben heute die stärkste Option für komplexe Reasoning-Aufgaben.

Aber du solltest deinen Workflow so gestalten, dass ein Anbieterausfall dich nicht stoppt. Das bedeutet:

- Behalte dein eigenes Verständnis. Überprüfe KI-generierten Code kritisch. Verstehe, was er tut und warum. Wenn du ein Modul nicht ohne Assistenten erklären kannst, besitzt du es noch nicht.

- Halte manuelle Kompetenz scharf. Schreibe Code ohne Assistenten regelmäßig. Nicht als Übung in Nostalgie — als Versicherung.

- Evaluiere lokale Modelle jetzt. Teste sie an deiner tatsächlichen Codebase. Wisse, was lokal funktioniert und was noch ein Cloud-Modell braucht.

- Trenne, was ein Netzwerk braucht von dem, was es nicht braucht. Sensibler Code sollte standardmäßig lokal verarbeitet werden. Bequemlichkeit überstimmt keine Sicherheit.

- Behandle KI-Zugang wie jede andere Abhängigkeit. Überwache ihn. Habe einen Fallback. Gehe nicht von 100% Uptime aus.

Das Muster wiederholt sich

Operations-Entwickler haben diese Lektion über zwei Jahrzehnte gelernt. Du vertraust keinem einzelnen Anbieter für Production-Uptime. Du baust Redundanz. Du planst für Ausfälle. Du besitzt deinen Recovery-Pfad.

Entwicklung befindet sich jetzt in derselben Position.

Deine Coding-Geschwindigkeit hängt von externer Infrastruktur ab. Wenn du nicht für ihre Abwesenheit planst, bist du kein Engineer — du hoffst.

Baue deinen KI-Workflow, wie du deine Production-Systeme baust. Erwarte Ausfälle. Designed darum herum. Besitze deinen Fallback.

Verfügbarkeit ist nicht garantiert. Kompetenz muss es sein.